À medida que a inteligência artificial se torna parte do cotidiano, termos como “entender”, “aprender” e “decidir” passaram a integrar descrições de sistemas de IA. Embora comumente usados, esses verbos carregam implicações que transcendem a simples comunicação. A escolha de palavras não apenas molda a compreensão do público sobre as tecnologias, mas também influencia debates […]

À medida que a inteligência artificial se torna parte do cotidiano, termos como “entender”, “aprender” e “decidir” passaram a integrar descrições de sistemas de IA. Embora comumente usados, esses verbos carregam implicações que transcendem a simples comunicação. A escolha de palavras não apenas molda a compreensão do público sobre as tecnologias, mas também influencia debates sobre responsabilidade e ética.

Leia também: IA generativa: 99% das organizações estão planejando novos investimentos

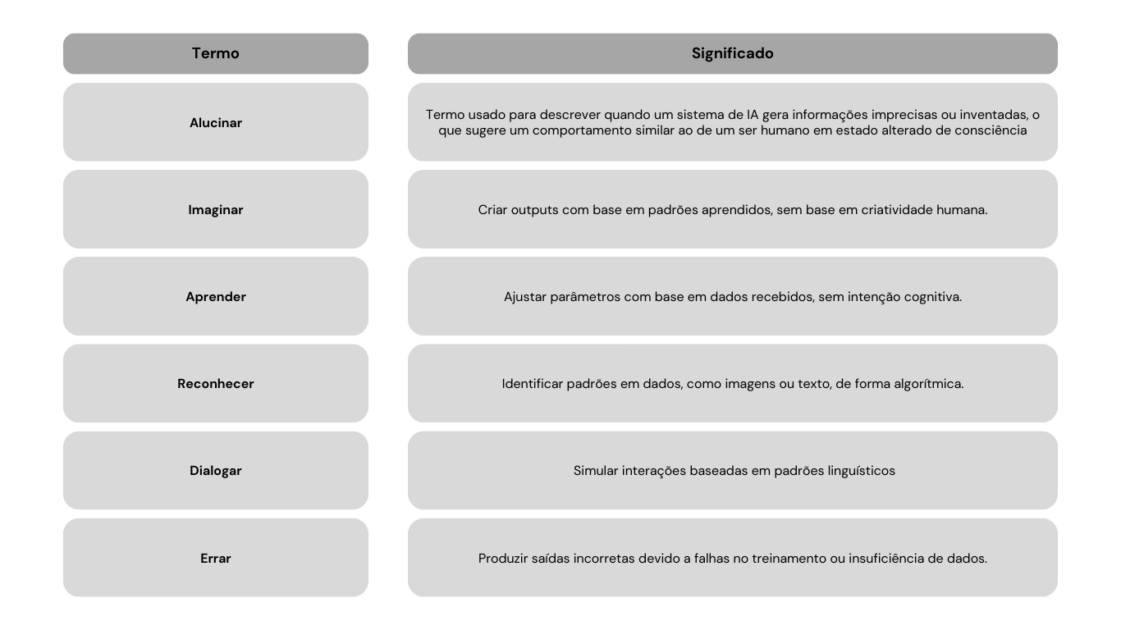

Para compreender melhor como esses termos operam e suas implicações, a seguir está uma tabela que detalha algumas das expressões mais comuns e seus significados técnicos:

Em entrevista ao IT Forum, Dora Kaufman, pesquisadora e autora do livro A inteligência artificial irá suplantar a inteligência humana?, destacou que o uso de termos antropomórficos confunde os usuários e transmite percepções equivocadas sobre as capacidades reais dessas soluções. “A ‘humanização’ na interface com as soluções de IA é proposital, a indústria explora esse aspecto para aumentar a atratividade de seus produtos, para incentivar o uso, para impressionar o usuário, para repercutir na mídia”, explicou.

O estudo Feels Like Empathy, apresentado na Australasian Conference on Information Systems, aprofunda a discussão ao introduzir o paradoxo da (des)humanização: ao atribuir características humanas a agentes de IA, corre-se o risco de esvaziar o valor dessas mesmas qualidades nos próprios humanos. Essa dinâmica, descrita como “empatia emergente”, sublinha que a empatia observada em sistemas de IA não é uma propriedade intrínseca da tecnologia, mas um fenômeno que emerge das interações entre humanos e máquinas.

Essa humanização da IA, contudo, levanta uma questão crucial: se a tecnologia é percebida como autônoma pelo público, quem deve assumir a responsabilidade por eventuais falhas ou prejuízos causados? Dora Kaufman é enfática: “A responsabilidade sobre os potenciais danos das soluções de IA é sempre dos seres humanos, sejam desenvolvedores, distribuidores ou aplicadores”. Essa perspectiva está alinhada com as conclusões do Feels Like Empathy, que ressalta a importância de uma supervisão ética robusta para mitigar riscos, especialmente em contextos sensíveis como saúde mental e sistemas judiciais.

A linguagem humanizada em tecnologia não é uma inovação recente. Desde os primórdios da computação, termos como “memória” e “cerebral” foram empregados para facilitar a compreensão pública. Porém, com o avanço da IA, essas expressões ganharam novas camadas de significado.

Inovações como a Emotion AI (também conhecida como computação afetiva ou inteligência emocional artificial), um subconjunto da IA que ‘mede, entende, simula e reage’ às emoções humanas, estão sendo cada vez mais usadas para entender, simular, reconhecer e reagir às emoções humanas. Ao captar nossas reações inconscientes, como microexpressões ou mudanças de inflexão, a Emotion AI reconhece mudanças sutis no humor ou nas emoções, como estresse ou raiva, e modula suas saídas de acordo.

Conforme a Emotion AI se integra cada vez mais à vida cotidiana, o estudo ressalta que seu impacto vai além da interação humano-máquina, estendendo-se às próprias relações humanas. A possibilidade de criar conexões emocionais com sistemas artificiais, ainda que simuladas, pode fomentar dependências emocionais e transformar as expectativas sobre o papel das emoções nos contextos sociais. Nesse sentido, refletir sobre os riscos dessa transformação é crucial para proteger o valor das interações genuinamente humanas.

Diante de um cenário de rápida evolução tecnológica, torna-se indispensável considerar o impacto ético das escolhas feitas na criação e no uso dessas ferramentas. Como afirmou Dora, “a ética rege a sociedade humana, neste caso como os humanos desenvolvem e adotam a tecnologia”.

Siga o IT Forum no LinkedIn e fique por dentro de todas as notícias!